Wenn ich an die aktuelle Debatte rund um künstliche Intelligenz denke, kommt mir oft eines in den Sinn: Wir sind fasziniert von der Technologie, aber manchmal vergessen wir, dass sie in einem größeren Zusammenhang steht. In einem kürzlich geführten Interview betonte Sundar Pichai, der CEO von Google, genau diesen Punkt – und zwar auf eine Weise, die bemerkenswert ruhig und reflektiert war. Statt in die allzu einfache Frage „Kann man der KI trauen?“ einzustimmen, sprach er darüber, dass KI nur ein Teil des Informationsökosystems ist. Dieses System, sagte er, bestehe aus vielen Komponenten: Suchmaschinen, Fachjournalismus, menschlichen Experten – und nicht zuletzt aus uns selbst, den Nutzern.

Ein Interview, das mehr verrät als Schlagzeilen

Das Gespräch mit der BBC wurde schnell zum Aufhänger für viele Schlagzeilen. Manch eine davon drehte Pichais Aussagen stark verkürzt zu Aussagen wie: „Vertraue KI nicht blind“. Solche Sätze klingen gut in Social Media, treffen aber nicht den Kern dessen, was Pichai wirklich meinte. Er wollte nicht sagen, dass KI gefährlich oder unbrauchbar ist – vielmehr, dass sie nicht in Isolation verstanden werden darf.

Aus seiner Sicht ist künstliche Intelligenz ein Werkzeug, ein Hilfsmittel, keine allwissende Quelle. „Man darf sie nicht als Wahrheit an sich sehen“, so sein Tenor. Und: Google arbeitet intensiv daran, die Antworten der KI über ein Verfahren namens „Grounding“ stärker mit überprüfbaren Informationen aus der realen Welt zu verknüpfen. Generative Modelle, also Systeme wie Gemini oder ChatGPT, formulieren ihre Antworten statistisch – sie „erraten“ gewissermaßen, was wahrscheinlich als Nächstes folgt. Genau das macht sie beeindruckend kreativ, aber eben nicht immer faktisch richtig.

Die Sache mit der Zuverlässigkeit

Der Interviewer ließ in dem Gespräch nicht locker. Er fragte Pichai immer wieder, ob KI zuverlässig ist, ob sie die Wahrheit sagt, ob sie die Welt nicht womöglich mit noch mehr Fehlinformation füttert. Doch Pichai wich solchen Vereinfachungen bewusst aus. Stattdessen betonte er, dass es gefährlich wäre, AI aus ihrem Kontext zu reißen. Denn Information im Jahr 2025 – und mehr noch in den kommenden Jahren – entsteht immer in einem Zusammenspiel verschiedener Quellen und Prozesse.

Man könne die KI, so Pichai, ähnlich sehen wie eine Lupe: Sie kann vergrößern, sichtbar machen, aber sie ersetzt nicht das tatsächliche Sehen. Der Mensch müsse lernen, diese Werkzeuge für das zu nutzen, wofür sie geschaffen sind. Will man Ideen entwickeln, Texte schreiben oder neue Perspektiven entdecken, kann KI ein fantastischer Partner sein. Wenn es aber um fundierte Daten, medizinische Entscheidungen oder komplexe wissenschaftliche Zusammenhänge geht, bleiben Suchmaschinen, Experten und Journalismus unersetzlich.

„Grounding“ – ein Blick in die Werkstatt

Ein besonders aufschlussreicher Teil des Interviews drehte sich um Googles Ansatz des „Grounding“. Dabei geht es darum, KI-Modelle mit echten, überprüfbaren Informationen zu „erden“. Im Grunde versucht man, das Beste aus zwei Welten zu vereinen: die kreative, flexible Formulierungskraft der generativen Modelle mit der Verlässlichkeit geprüfter Daten. Pichai machte deutlich, dass dieser Prozess noch nicht abgeschlossen ist. Er sprach offen über die Grenzen: „Diese Systeme haben eine statistische Basis. Sie machen Fehler.“ Aber er fügte hinzu, dass genau daran gearbeitet wird – und dass die Integration von Google Search als Faktenanker ein Schlüssel sei.

Ich finde besonders diesen Punkt wichtig. Es zeigt, dass selbst an der Spitze des Tech-Giganten das Bewusstsein dafür vorhanden ist, dass KI nicht perfekt ist. Es geht nicht um den nächsten Hype, sondern um den nüchternen Blick darauf, was solche Systeme leisten können – und was nicht.

Werkzeuge mit Sinn und Verstand nutzen

Interessant war auch, wie Pichai im weiteren Gespräch die Parallele zwischen Suchmaschinen und KI zog. Er sagte sinngemäß: „Man nutzt Tools für das, wofür sie gedacht sind.“ Search liefert Fakten, Zahlen, verifizierte Informationen. KI hingegen inspiriert zu neuen Ideen oder unterstützt beim kreativen Denken. Diese Aufteilung ist kein Widerspruch, sondern eher eine Art natürlicher Arbeitsteilung.

Ich erinnere mich, wie vor Jahren ähnliche Diskussionen über das Internet selbst geführt wurden: „Kann man allem glauben, was online steht?“ Heute wirkt diese Frage fast naiv. In wenigen Jahren werden wir wohl ähnlich auf die jetzigen KI-Debatten blicken. Der Umgang mit Information entwickelt sich – aber das bedeutet eben auch, dass digitale Mündigkeit wichtiger ist denn je.

Ein Beispiel aus dem Alltag

Wenn ich eine neue Strategieplane oder Forschungsideen entwickle, probiere ich oft zuerst ein KI-Tool aus, um grobe Strukturen zu entwerfen oder Perspektiven zu sammeln. Aber der entscheidende Schritt – das Nachprüfen, das Hinterfragen, das Verstehen – bleibt bei mir. Genau das meinte Pichai, als er sagte: „Man darf nicht alles glauben, was ein KI-System sagt.“ Dieses „nicht alles glauben“ ist kein Misstrauensbekenntnis, sondern eine Ermutigung zur Eigenverantwortung.

Die Stärke der menschlichen Expertise

Der wohl eindrucksvollste Abschnitt des Interviews kam gegen Ende, als der BBC-Moderator erneut betonte, dass Google mitverantwortlich sei, weil die KI-Technologie – insbesondere Transformer-Modelle – ursprünglich dort entwickelt wurde. Ob Pichai also nicht Sorge habe, dass durch AI die Welt weniger verlässlich werde? Seine Antwort war bemerkenswert ruhig:

„Nur wenn man sich ausschließlich auf solche Systeme verlässt“, sagte er. Deshalb müsse das Informationsökosystem reicher bleiben als nur eine Sammlung von KI-Tools. Damit meinte er: Wahrheit, kritisches Denken, journalistische Arbeit und Expertenaustausch bleiben zentral. Er erwähnte Beispiele – Lehrer, Ärzte, Reporter –, die stellvertretend für das menschliche Wissen und Verantwortungsbewusstsein stehen.

Mich hat dieser Gedanke beeindruckt, weil er eine Haltung ausdrückt, die wir im digitalen Zeitalter oft vergessen: Technologie ist kein Ersatz für menschliches Denken. Sie ist eine Erweiterung. Und je schneller sie wird, desto bewusster müssen wir uns darum kümmern, was verlässlich, relevant und demokratisch bleibt.

AI in der Kultur des Lernens

Pichais Betonung auf Lehrer und Ärzte ist kein Zufall. In Bildung und Gesundheit geht es um Vertrauen und Verantwortung – zwei Dinge, die sich nicht algorithmisch berechnen lassen. Wenn ein Schüler eine Frage stellt, geht es nicht nur um die Antwort, sondern auch um die Beziehung zwischen Lehrer und Lernendem. Ein Arzt wiederum hört zwischen den Zeilen, liest Körpersprache, versteht Ängste. KI kann Diagnosevorschläge machen, aber sie ersetzt dieses menschliche Einfühlungsvermögen nicht.

In dieser Perspektive wird klar, dass Pichai nicht einfach über Technik spricht, sondern über gesellschaftlichen Zusammenhalt. Seine Nachricht war: Nur wenn wir ein vielfältiges, verantwortungsvolles Informationsnetz pflegen, kann KI sinnvoll Teil davon sein.

Warum der Kontext entscheidend ist

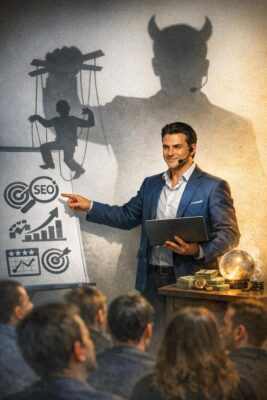

Was mich an diesem Interview besonders beschäftigt hat, ist, wie unterschiedlich es interpretiert wurde. Viele Kommentare auf Plattformen wie X oder LinkedIn boten schnelle Schlussfolgerungen: „Sogar Google warnt vor KI!“ Doch Pichai warnte nicht – er kalibrierte. Er stellte klar, dass keine einzelne Technologie das Monopol auf Wahrheit haben sollte. In einer Welt, die immer komplexer wird, besteht Stärke nicht in Vereinfachung, sondern im Zusammenspiel vieler Systeme.

Das ist auch eine Lektion für uns Marketer, Kommunikatoren und Analysten: Wenn wir uns zu sehr auf automatisierte Tools verlassen, verlieren wir das Gespür für Kontext, Nuance und kulturelle Unterschiede. AI ohne Kontext ist Statistik; AI mit Kontext ist Insight.

KI und die Zukunft der Suche

Pichais Gedanken zeigen indirekt, wie Google selbst KI in das bestehende Suchökosystem integriert: nicht als Ersatz, sondern als Ergänzung. Die Einführung von generativen Suchantworten (AIO) folgt genau diesem Prinzip. Anstatt starre Ergebnisse zu listen, werden komplexe Themen visualisiert, zusammengefasst und mit Quellen versehen – also eine Art symbiotische Beziehung zwischen „KI als Assistent“ und „Suche als Faktenbasis“.

Ich sehe darin keinen Kontrollverlust, sondern einen natürlichen Entwicklungsschritt. Es ist, als hätte die Informationssuche endlich gelernt, mit Unschärfen und Mehrdeutigkeiten produktiv umzugehen – etwas, das Menschen ohnehin tun. Die Herausforderung liegt darin, dass wir lernen müssen, die neuen Schichten der Informationslandschaft zu navigieren.

Fazit: Ein reicheres Informationsökosystem

Nach dem Gespräch bleibt für mich vor allem eine Erkenntnis: KI verändert die Art, wie wir mit Wissen umgehen – aber sie definiert sie nicht neu. Wenn wir sie verantwortungsvoll einsetzen, kann sie Wissen demokratisieren, Kreativität fördern und Entscheidungsprozesse beschleunigen. Doch sobald wir sie zum alleinigen Richter über Wahrheit machen, verlieren wir die Balance.

Pichai brachte es auf eine schlichte, fast unspektakuläre Formel: Wir müssen lernen, Technologien für das zu nutzen, wofür sie gedacht sind. Das klingt unspektakulär, ist aber, je länger man darüber nachdenkt, die eigentliche Herausforderung unserer Zeit. KI, so wie er sie versteht, ist Teil eines riesigen, lebendigen Systems aus Menschen, Daten, Kultur, Kommunikation, und Verantwortung – ein System, das nur dann lebendig bleibt, wenn wir es gemeinsam gestalten.

Es wäre zu einfach, daraus nur die Warnung „Vertraue KI nicht“ zu machen. Tatsächlich sagte Pichai etwas weitaus Wichtigeres: Vertraue deinem eigenen kritischen Denken. Denn nur so bleibt das Informationsökosystem wirklich reich – reicher als jede KI es je sein könnte.