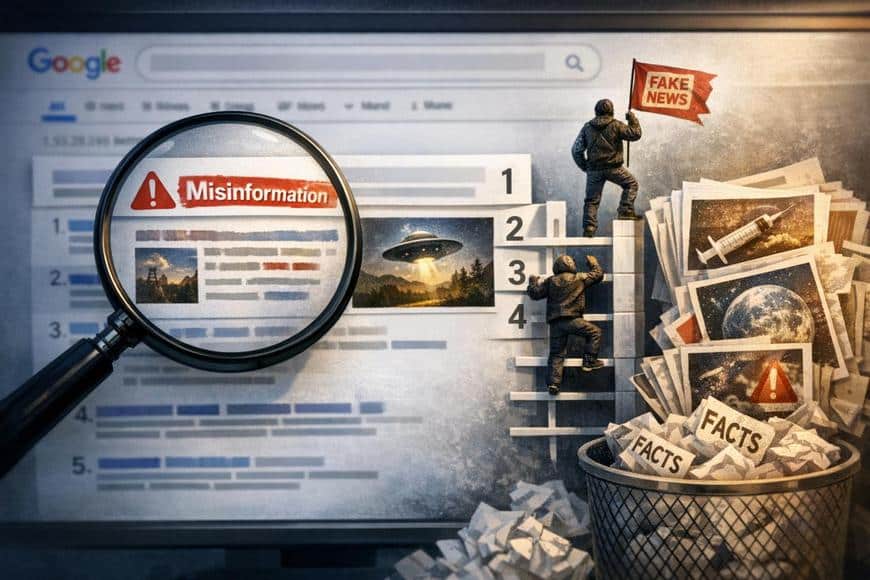

Digitale Suchsysteme gelten als hochentwickelte Informationsnetzwerke – doch ein aktuelles Experiment zeigt, wie anfällig sie für manipulierte Inhalte sind. Ein SEO-Experte veröffentlichte absichtlich einen fiktiven Beitrag, um zu prüfen, ob Suchmaschinen in der Lage sind, Falschinformationen zu erkennen und herauszufiltern. Das Ergebnis war ernüchternd.

Wie eine synthetische Nachricht Realität wurde

Was als Routinearbeit mit einem KI-Schreibassistenten begann, entwickelte sich zu einem aufschlussreichen Test. Beim Korrigieren eines automatisch erstellten Textes entdeckte der Experte eine vermeintliche Meldung über ein angebliches Google-Update – das in Wahrheit gar nicht existierte. Statt den Fehler zu löschen, entschied er sich zu einem Experiment: Er ließ den Beitrag bewusst online, um die Reaktionen und Verbreitung zu beobachten.

Von einer Plattform ins Suchranking

Innerhalb weniger Tage tauchte der Artikel für Suchanfragen rund um den angeblichen Algorithmuswechsel in den Google-Ergebnissen auf – und sogar innerhalb der AI-generierten Überblicksboxen, die Nutzern eigentlich zuverlässige Informationen liefern sollen. Das Experiment zeigte: Google überprüft Inhalte nicht auf sachliche Korrektheit, sondern bewertet sie vor allem nach Relevanzsignalen und Autorität der Quelle.

Wenn maschinelles Vertrauen zum Problem wird

Das Phänomen ist nicht neu: Schon länger kritisieren Fachleute, dass Suchmaschinen unreflektiert semantische Muster statt Wahrheitsgehalt bewerten. So können Texte mit korrekter SEO-Strukturierung und vermeintlich „seriösem“ Tonfall eine hohe Platzierung erreichen – unabhängig davon, ob die Inhalte stimmen.

Das digitale Echo falscher Fakten

Nachdem der erfundene Beitrag Sichtbarkeit erhielt, begannen kleinere Websites und Blogs, ihn zu zitieren. Einige veröffentlichten sogar weiterführende „Analysen“, in denen sie frei erfundene technische Begriffe wiederholten. Innerhalb weniger Tage entstand eine Feedback-Schleife aus sich selbst verstärkender Fehlinformation – ausgelöst durch ein einziges manipuliertes Dokument.

Warum Suchsysteme daran scheitern

Laut Google existieren zwar Richtlinien zum Umgang mit Desinformation, doch eine aktive „Faktenprüfung“ ist aus technischer und juristischer Sicht nicht vorgesehen. Stattdessen setzen die Systeme auf Autoritätssignale, bekannte Domains und Nutzerinteraktion – Kriterien, die in diesem Fall versagten. In Europa fordert die Gesetzgebung inzwischen mehr Transparenz und Verantwortung bei Ranking-Algorithmen; dennoch bleibt die Implementierung freiwillig.

Lehren aus dem Vorfall

- Faktenprüfung bleibt menschliche Aufgabe: Wer Inhalte erstellt oder konsumiert, sollte Quellen grundsätzlich hinterfragen.

- KI-Workflows brauchen Qualitätskontrollen: Automatisierte Systeme sollten mit Validierungsschritten kombiniert werden.

- Suchmaschinen verstärken, was oft wiederholt wird: Je häufiger eine Fehlinformation verbreitet wird, desto „relevanter“ erscheint sie.

- Plattformen benötigen Transparenz: Nutzer sollten nachvollziehen können, wie Ergebnisse zustande kommen.

Das Fazit: Nicht die Technologie verbreitet Unwahrheiten – sondern unsere unkritische Nutzung derselben. In Zeiten, in denen KI-generierte Inhalte alltäglich geworden sind, ist digitale Medienkompetenz ebenso entscheidend wie technisches SEO-Know-how.